Onde a IA falha em projetos de arquitetura e engenharia

Carreguei o projeto arquitetônico completo de uma indústria no Claude. Na análise por prancha, acerto. No conjunto, erro grave. O AEC-Bench, primeiro benchmark científico de IA em projetos AEC, explica por quê — e mostra onde já existe solução

Leitura de 2 minutos

O que me chamou atenção...

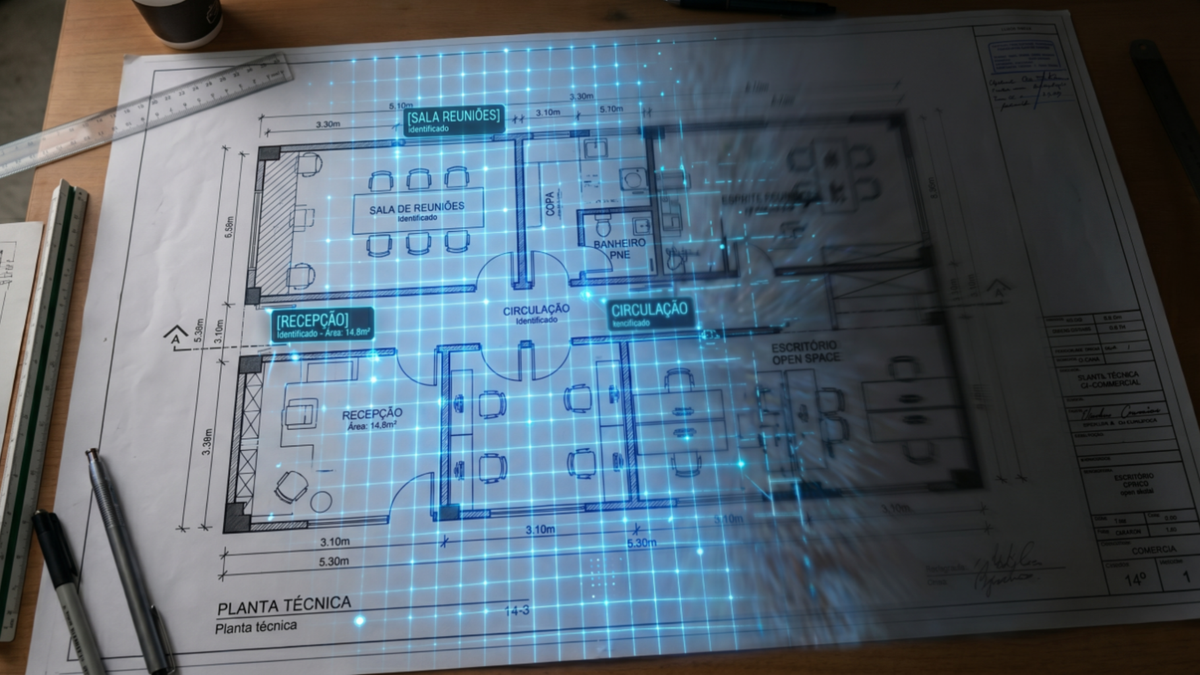

No início deste ano, carreguei no Claude o projeto arquitetônico completo de uma indústria composta por múltiplos edifícios. O objetivo era validar o dimensionamento das instalações sanitárias para cerca de 300 funcionários, conforme a NR-24 e a NBR 9050 — considerando turnos de trabalho, acessibilidade e distribuição entre os edifícios e seus pavimentos.

Analisando prancha por prancha, o resultado foi preciso: extração de quantitativos, verificação de dimensões, checagem de distâncias mínimas. Um tipo de análise que levaria horas de um profissional experiente — executada em minutos.

Então pedi a análise do conjunto.

O modelo perdeu a coerência global. Associou sanitários a pavimentos incorretos e indicou conformidade onde, na planta de conjunto, havia não conformidade evidente.

Não foi exatamente uma falha da ferramenta — foi uma mudança de escala que eu não havia enquadrado corretamente.

O ponto

Em 2026, a maioria dos escritórios de arquitetura já utiliza IA no dia a dia. ChatGPT, Claude, Gemini — a adoção deixou de ser barreira.

O problema agora é outro: nível de uso.

Consultas pontuais, sem método, sem delimitação clara de escopo. A ferramenta devolve respostas plausíveis — e plausibilidade não é garantia de conformidade. No fim, a responsabilidade continua sendo de quem assina.

Mas o dado que realmente me chamou atenção foi outro.

Em março de 2026, a Nomic AI publicou o AEC-Bench — o primeiro benchmark científico voltado à avaliação de agentes de IA em tarefas reais de coordenação de projetos, com 196 instâncias curadas por especialistas.

Os resultados confirmam um padrão: a IA generalista compreende bem o texto, mas ainda não aprofunda a leitura dos desenhos a que esse texto se refere.

- Em análises textuais sobre uma prancha isolada, o desempenho chega a 87% — um nível já confiável.

- Mas, ao interpretar representação técnica (símbolos, convenções gráficas), o desempenho cai significativamente. Em elementos como linhas de chamada, o melhor resultado foi de 43%.

- No cruzamento entre múltiplos documentos — cenário típico de coordenação —, o desempenho despenca para 23%.

O modelo não percorre o projeto como um coordenador percorre.

O ponto mais relevante para o profissional:

Soluções especializadas — treinadas em representação técnica e estruturadas com RAG — já conseguem interpretar o que modelos generalistas não conseguem. Em navegação entre documentos de projeto, atingem 100% de acerto no benchmark.

A tecnologia já existe. Mas não está no chat genérico da assinatura mensal.

Em resumo

A IA generalista já resolve uma parcela significativa do trabalho técnico — desde que o escopo esteja bem definido e haja supervisão.

Mas, quando entramos em representação técnica e análise de conjunto, estamos falando de outra categoria de problema — e de outra categoria de ferramenta.

Na próxima verificação normativa, antes de aceitar a resposta da IA, faça uma única pergunta:

essa ferramenta foi feita para interpretar a representação técnica do seu projeto — ou apenas para responder bem sobre o que está escrito nele?

Escrevo periodicamente aqui no LinkedIn — e também no Substack.

Sérgio Salles | www.arquiteto.com.br

Notas

NR-24 — Condições Sanitárias e de Conforto nos Locais de Trabalho: Norma Regulamentadora do Ministério do Trabalho que define requisitos mínimos para instalações sanitárias em ambientes de trabalho. O dimensionamento é vinculado ao número de trabalhadores por turno e varia por setor de atividade.

NBR 9050 — Acessibilidade a edificações: Norma ABNT de aplicação obrigatória em edificações de uso coletivo. Define dimensões mínimas, raios de giro e configuração de sanitários acessíveis.

Linha de chamada: Linha auxiliar do desenho técnico que conecta uma nota textual ao elemento gráfico ao qual ela se refere. Sua leitura correta exige interpretação espacial — capacidade ainda limitada nas IAs generalistas, mas resolvida por sistemas treinados em representação técnica.

AEC-Bench: Benchmark multimodal publicado pela Nomic AI em 31/03/2026. Avalia agentes de IA em 196 tarefas reais de coordenação de projetos, organizadas em três níveis de complexidade crescente: prancha isolada, conjunto de desenhos e projeto completo com especificações. nomic.ai

RAG — Retrieval-Augmented Generation: Técnica que conecta modelos de linguagem a bases de dados estruturadas externas antes de gerar uma resposta. Aplicada a desenhos técnicos por sistemas especializados, permite que a IA localize geometria, símbolos e referências cruzadas — transformando o PDF em dado navegável. No AEC-Bench, agentes com esse suporte atingiram 100% de acerto em navegação de documentos de projeto.